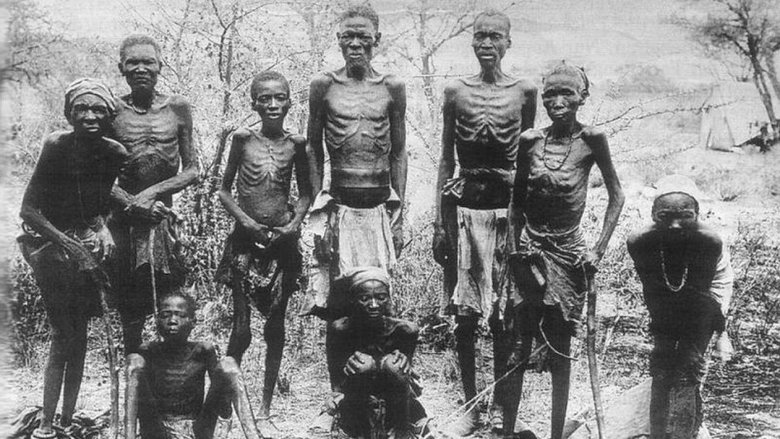

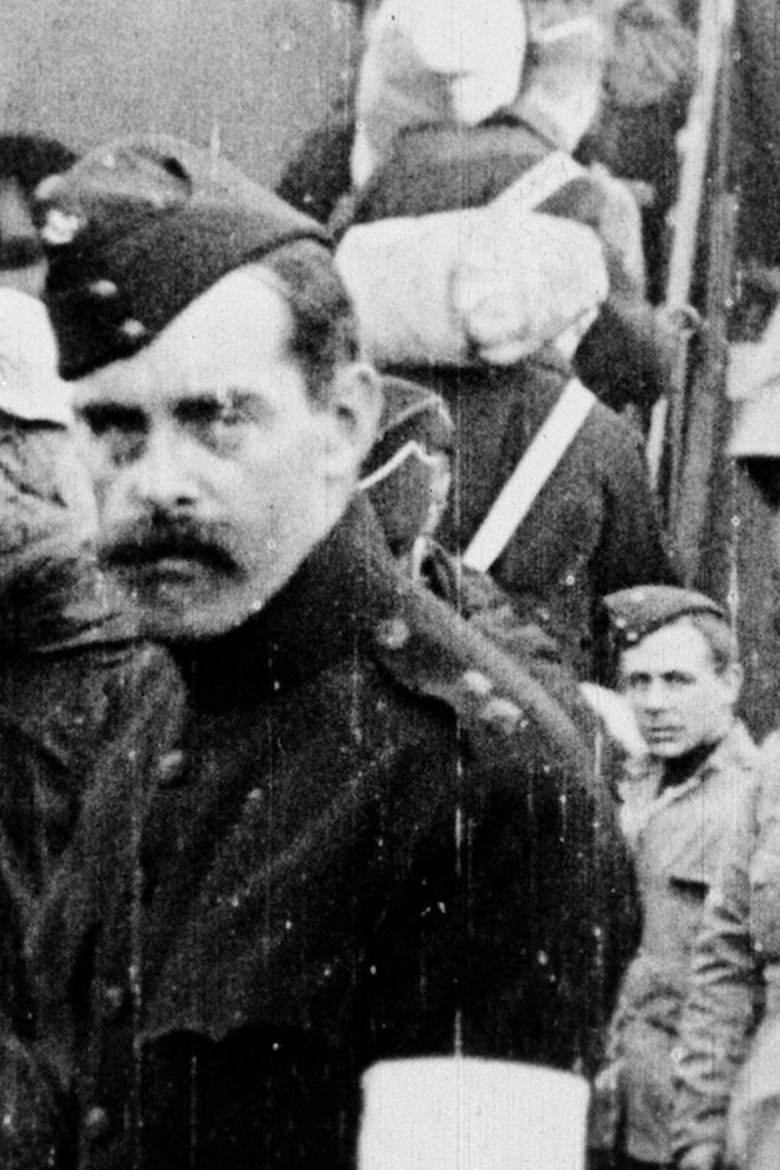

Unter Herrenmenschen — Der deutsche Kolonialismus in Namibia

2019·53 min

Die Deutschen kolonisierten das Land Namibia im südlichen Afrika während eines kurzen Zeitraums von 1840 bis zum Ende des Ersten Weltkriegs. Die Geschichte des so genannten Deutsch-Südwestafrikas (1884-1915) ist abscheulich; ein versteckter und verschwiegener Bericht über Plünderung und Völkermord.

Genres:

Dokumentation·Geschichte·TV-Film

Poster

1

Bilder

7

Darsteller

Crew

Info

Unter Herrenmenschen — Der deutsche Kolonialismus in Namibia

Veröffentlicht

22.4.2019

Deutsch

Bewertungen·0

?/10